اتصال ابزار به LLM با MCP؛ راهنمای کامل یکپارچه سازی پایتون

5دقیقه

آنچه در این مقاله میخوانید [پنهانسازی]

اتصال ابزار به LLM با MCP تحولی بزرگ در نحوه تعامل هوش مصنوعی با دنیای واقعی ایجاد کرده است. پروتکل کانتکست مدل ($Model Context Protocol$) به توسعه دهندگان اجازه می دهد تا محدودیت های دانش ایستا در مدل های زبانی بزرگ را شکسته و آن ها را به دیتابیس ها، فایل های محلی و سرویس های آنلاین متصل کنند. با استفاده از پایتون، شما می توانید یک پل ارتباطی استاندارد بسازید که هوش مصنوعی از طریق آن، دستورات اجرایی را به سیستم شما ارسال کند. در این مقاله از سایت کدیتی، فرآیند دقیق و فنی این اتصال را به صورت گام به گام بررسی خواهیم کرد.

سرفصل های مقاله

- چرا به پروتکل MCP برای اتصال ابزارها نیاز داریم

- ساختار ارتباطی میان کلاینت و سرور در MCP

- ابزارهای مورد نیاز و نصب کتابخانه MCP پایتون

- تعریف اولین ابزار (Tool) برای مدل زبانی

- مدیریت داده های ورودی و خروجی در پروتکل

- امنیت و کنترل دسترسی ها در زمان اتصال

- تست و عیب یابی اتصال ابزارها

- جمع بندی نهایی و قدرت بخشیدن به AI

چرا به پروتکل MCP برای اتصال ابزارها نیاز داریم

در گذشته، برای اتصال ابزار به LLM با MCP یا روش های مشابه، هر شرکت هوش مصنوعی پروتکل خاص خود را داشت که باعث سردرگمی برنامه نویسان می شد. اما $MCP$ به عنوان یک استاندارد جهانی معرفی شد تا یک بار کدنویسی کنید و به تمام مدل ها ($Claude$، $Gemini$ و غیره) متصل شوید. این پروتکل امنیت داده ها را تضمین می کند و اجازه می دهد کانتکست یا همان زمینه موضوعی، به صورت بسیار دقیق و ساختاریافته به مدل منتقل شود. این یعنی هوش مصنوعی دیگر حدس نمی زند، بلکه با دسترسی به ابزارهای شما، پاسخ های مستند و واقعی ارائه می دهد.

ساختار ارتباطی میان کلاینت و سرور در MCP

معماری این سیستم بر پایه یک الگوی کلاینت-سرور بسیار مدرن بنا شده است. در فرآیند اتصال ابزار به LLM با MCP، برنامه پایتونی شما نقش سرور را ایفا می کند که ابزارها ($Tools$) را میزبانی می نماید. اپلیکیشن هوش مصنوعی نیز به عنوان کلاینت، درخواست های خود را در قالب پیام های استاندارد ارسال می کند. این جداسازی باعث می شود که شما بتوانید سرور خود را روی هر سیستمی اجرا کنید و فقط دسترسی های لازم را به مدل بدهید. این ساختار ماژولار، کلید اصلی مقیاس پذیری در پروژه های بزرگ هوش مصنوعی در کدیتی است.

ابزارهای مورد نیاز و نصب کتابخانه MCP پایتون

برای شروع عملیات اتصال ابزار به LLM با MCP، ابتدا باید محیط توسعه پایتون خود را به کتابخانه های رسمی مجهز کنید. پایتون به دلیل کتابخانه های قدرتمندی که برای این پروتکل عرضه شده، بهترین زبان برای ساخت سرورهای $MCP$ محسوب می شود. شما به پایتون نسخه 3.10 به بالا نیاز دارید تا بتوانید از قابلیت های پیشرفته مدیریت پیام ها استفاده کنید. نصب کتابخانه اصلی اولین قدم برای تعریف توابعی است که قرار است در اختیار هوش مصنوعی قرار بگیرند.

Python

pip install mcp

تعریف اولین ابزار (Tool) برای مدل زبانی

در مرحله اصلی اتصال ابزار به LLM با MCP، شما باید توابع پایتونی خود را به گونه ای بنویسید که برای هوش مصنوعی قابل درک باشند. هر ابزار باید دارای یک نام منحصر به فرد و از همه مهم تر، یک “توضیحات” ($Description$) بسیار دقیق باشد. هوش مصنوعی از این توضیحات استفاده می کند تا بفهمد چه زمانی باید این ابزار خاص را فراخوانی کند. برای مثال، اگر ابزاری برای خواندن فایل های $CSV$ دارید، باید دقیقاً ذکر کنید که این ابزار چه نوع داده هایی را برمی گرداند تا مدل بتواند در برنامه ریزی های خود از آن استفاده کند.

Python

from mcp.server.fastmcp import FastMCP

# ایجاد سرور اتصال ابزار

mcp_app = FastMCP("Data Tool connector")

@mcp_app.tool()

def get_system_report(area: str) -> str:

"""دریافت گزارش فنی از بخش های مختلف سیستم برای هوش مصنوعی"""

return f"گزارش بخش {area} آماده ارسال است."

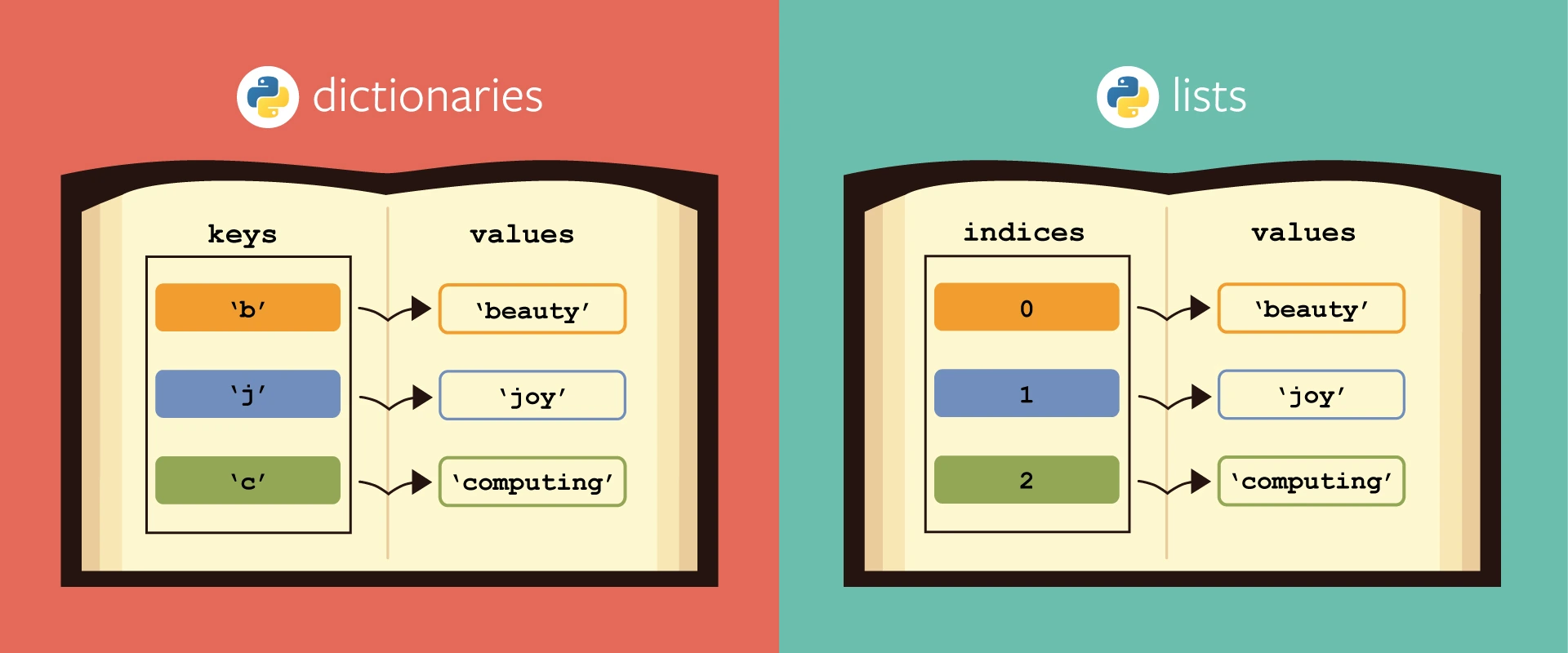

مدیریت داده های ورودی و خروجی در پروتکل

یکی از بخش های حساس در اتصال ابزار به LLM با MCP، تبدیل داده ها به فرمت قابل فهم برای پروتکل است. تمام پیام ها باید با استاندارد $JSON-RPC$ مطابقت داشته باشند. کتابخانه $FastMCP$ در پایتون، این وظیفه سنگین را به صورت خودکار انجام می دهد و ورودی های مدل را به متغیرهای پایتونی تبدیل می کند. در مقابل، خروجی تابع شما نیز باید به شکلی باشد که مدل بتواند از آن در پاسخ نهایی خود استفاده کند. مدیریت صحیح خطاها در این بخش بسیار حیاتی است تا اگر ابزاری با شکست مواجه شد، مدل بتواند استراتژی خود را تغییر دهد.

امنیت و کنترل دسترسی ها در زمان اتصال

وقتی صحبت از اتصال ابزار به LLM با MCP می شود، امنیت بزرگترین دغدغه است. دادن دسترسی به هوش مصنوعی برای اجرای کد یا خواندن فایل ها می تواند خطرناک باشد. پایتون به شما اجازه می دهد تا لایه های امنیتی متعددی ایجاد کنید. همیشه ورودی های مدل را قبل از پردازش نهایی اعتبارسنجی کنید و از محیط های ایزوله ($Sandbox$) برای اجرای دستورات حساس استفاده نمایید. همچنین می توانید لیستی از دستورات مجاز تعریف کنید تا هوش مصنوعی نتواند فراتر از وظیفه تعیین شده عملیاتی انجام دهد.

تست و عیب یابی اتصال ابزارها

برای اطمینان از صحت اتصال ابزار به LLM با MCP، نباید مستقیماً به سراغ تست با مدل های گران قیمت بروید. استفاده از ابزارهای $Inspector$ که توسط تیم توسعه پروتکل ارائه شده، به شما اجازه می دهد سرور پایتونی خود را در یک محیط گرافیکی تست کنید. در این محیط، شما می توانید ابزارها را به صورت دستی فراخوانی کرده و خروجی های $JSON$ را بررسی کنید. این مرحله از دیباگ کردن به شما کمک می کند تا از فرمت صحیح داده ها و سرعت پاسخ دهی سرور خود مطمئن شوید.

جمع بندی نهایی و قدرت بخشیدن به AI

در نهایت، اتصال ابزار به LLM با MCP مهارتی است که مرز بین یک چت بات ساده و یک دستیار هوشمند واقعی را تعیین می کند. پایتون با سادگی و قدرت خود، فرآیند پیاده سازی این پروتکل پیچیده را به یک تجربه لذت بخش تبدیل کرده است. با استفاده از این راهنما در کدیتی، شما اکنون می توانید هوش مصنوعی خود را به ابزارهای اختصاصی مجهز کنید و کارایی پروژه های خود را به سطح جدیدی ببرید. آینده هوش مصنوعی در گرو تعامل هوشمندانه با ابزارهای دنیای واقعی است.