همهچیز درباره RAG و Fine-tuning؛ دو روش کلیدی برای بهبود مدلهای زبانی

4دقیقه

آنچه در این مقاله میخوانید [پنهانسازی]

در دنیای هوش مصنوعی و مدلهای زبانی بزرگ، همیشه این پرسش مطرح است که برای شخصیسازی یک مدل، باید آن را دوباره آموزش دهیم یا کافی است به آن دادههای جدید بدهیم؟

دو روش اصلی برای این کار وجود دارد: RAG (Retrieval-Augmented Generation) و Fine-tuning. هر دو روش به بهبود عملکرد مدل در حوزههای خاص کمک میکنند، اما فلسفه و کاربردشان کاملاً متفاوت است.

در این مقاله میخواهیم دقیقتر ببینیم RAG و Fine-tuning چه هستند، چطور کار میکنند و در چه شرایطی باید از هر کدام استفاده کرد.

سرفصل های مقاله

RAG چیست؟

RAG یا تولید تقویتشده با بازیابی روشی است که به مدل زبانی اجازه میدهد هنگام پاسخگویی، از منابع بیرونی استفاده کند.

در این روش، مدل دانش جدید را از پایگاه دادهها، فایلهای PDF، وبسایتها یا APIها بازیابی کرده و آن را در پاسخ خود به کار میبرد.

به این ترتیب، بدون نیاز به آموزش مجدد مدل، میتوان اطلاعات بهروز و تخصصی را وارد فرآیند پاسخدهی کرد.

مثلاً فرض کنید چتبات شما باید بر اساس آخرین گزارشهای مالی پاسخ دهد. بهجای اینکه هر بار مدل را آموزش دهید، RAG اطلاعات جدید را از دیتابیس میخواند و با دانش درونی مدل ترکیب میکند.

مزایای RAG

- بهروزرسانی سریع: تغییر دادهها بدون نیاز به آموزش مجدد مدل.

- کاهش هزینهها: نیازی به GPU یا منابع سنگین برای فاینتیونینگ نیست.

- افزایش دقت پاسخها: چون دادهها از منابع واقعی گرفته میشوند.

Fine-tuning چیست؟

در مقابل، Fine-tuning یعنی بازآموزی مدل با دادههای خاص خودتان.

در این روش، وزنها و پارامترهای مدل تغییر میکنند تا رفتار و دانش آن بهصورت دائمی اصلاح شود.

به بیان دیگر، مدل واقعاً یاد میگیرد که اطلاعات جدید را در ساختار خود بگنجاند.

برای مثال، اگر بخواهید یک مدل عمومی مثل GPT را به یک مدل تخصصی در حوزه حقوق یا پزشکی تبدیل کنید، باید از Fine-tuning استفاده کنید.

مزایای Fine-tuning

- یادگیری عمیقتر: مدل مفاهیم جدید را درونی میکند.

- دقت بالا در زبان تخصصی: بهویژه در حوزههایی مثل حقوق، داروسازی یا مالی.

- استقلال از منبع داده: چون دانش درون مدل ذخیره میشود.

تفاوت RAG و Fine-tuning در یک نگاه

| ویژگی | RAG | Fine-tuning |

|---|---|---|

| نوع تعامل با داده | استفاده از دانش بیرونی در لحظه | آموزش مجدد مدل با دادههای داخلی |

| تغییر در ساختار مدل | ندارد | دارد |

| سرعت و هزینه پیادهسازی | بالا و ارزان | کندتر و پرهزینهتر |

| نیاز به بهروزرسانی مداوم | ساده | دشوار |

| مناسب برای | اطلاعات پویا (مثل اخبار) | اطلاعات پایدار و تخصصی (مثل مستندات فنی) |

چه زمانی از RAG استفاده کنیم؟

اگر دادههای شما پویا و در حال تغییر هستند، RAG بهترین گزینه است.

مثلاً:

- سیستمهایی که نیاز به اطلاعات روز دارند (مثل خبرگزاریها یا موتورهای جستوجو).

- پشتیبانی مشتری با اسناد متغیر یا پرسشهای متنوع.

- مدلهایی که باید از چند منبع داده استفاده کنند.

در این شرایط، RAG با سرعت بالا اطلاعات را از منابع جدید میگیرد و پاسخهای دقیق و بهروز ارائه میدهد.

چه زمانی Fine-tuning مناسبتر است؟

اگر دادههای شما ثابت و تخصصی هستند، Fine-tuning انتخاب بهتری است.

برای مثال:

- مدلهایی که باید زبان فنی خاصی را یاد بگیرند (مثل پزشکی یا حقوق).

- دستیارهای هوش مصنوعی برای سازمانهایی که نیاز به دانش اختصاصی دارند.

- سیستمهایی که نیازی به اتصال به دادههای زنده ندارند.

Fine-tuning باعث میشود مدل واقعاً “درک” کند، نه صرفاً “نقل قول” از دادهها.

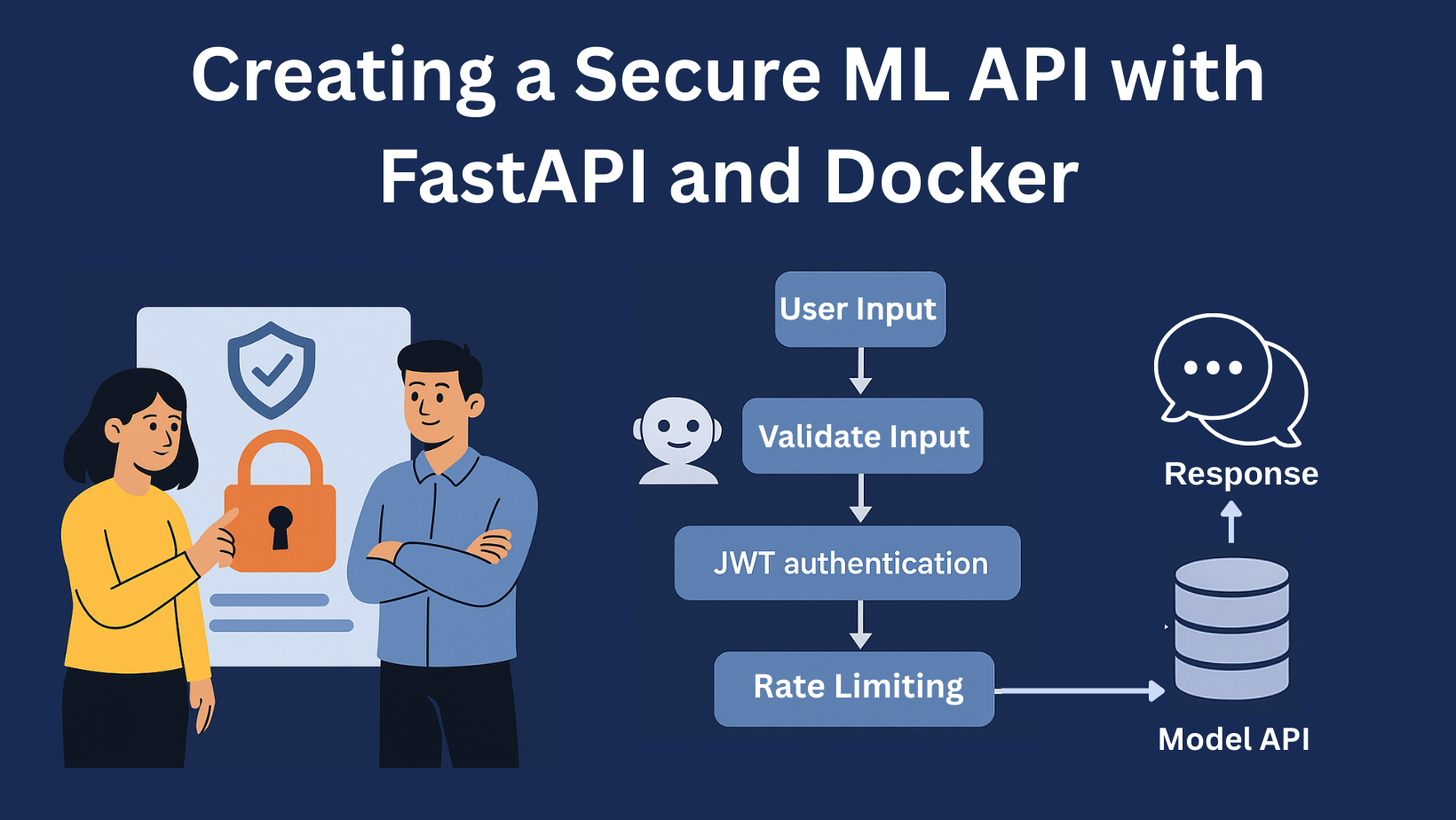

ترکیب RAG و Fine-tuning؛ ترکیب برنده در مدلهای مدرن

مدلهای پیشرفته امروزی، از ترکیب هر دو روش استفاده میکنند.

به این صورت که:

- مدل با Fine-tuning آموزش میبیند تا زبان تخصصی و حوزه کاری شما را درک کند.

- سپس RAG به آن متصل میشود تا همیشه به دادههای جدید و منابع بیرونی دسترسی داشته باشد.

بهعنوان مثال، ChatGPT Enterprise و Gemini Team Edition از همین معماری استفاده میکنند. این مدلها هم حافظه بلندمدت دارند و هم میتوانند به دادههای بهروز سازمانی متصل شوند.

چالشها و محدودیتها

هرچند هر دو روش مفیدند، اما محدودیتهایی هم دارند:

- در RAG، اگر دادههای منبع بیکیفیت باشند، پاسخها اشتباه خواهند بود.

- در Fine-tuning، اگر دادهها کم یا نادرست باشند، مدل دچار خطا و بیشبرازش (Overfitting) میشود.

بنابراین کیفیت داده، چه در RAG و چه در Fine-tuning، مهمترین عامل موفقیت است.

آینده شخصیسازی مدلهای زبانی

در آینده، مرز بین RAG و Fine-tuning کمرنگتر خواهد شد.

مدلهای نسل بعدی مثل GPT-6، Claude 5 و Gemini 4 احتمالاً بهصورت خودکار تصمیم خواهند گرفت چه زمانی داده جدید را از بیرون بازیابی کنند و چه زمانی دانش خود را بازآموزی کنند.

این همان چیزی است که محققان MIT با فریمورک SEAL از آن به عنوان “خودتکاملی مدلها” یاد میکنند — جایی که مدل خودش دادههای مفید را یاد میگیرد، ذخیره میکند و از آنها استفاده میکند.

جمع بندی

RAG و Fine-tuning دو مسیر متفاوت برای بهبود مدلهای زبانی هستند.

RAG با تزریق لحظهای دادههای جدید، مدل را بهروز نگه میدارد، در حالی که Fine-tuning با یادگیری واقعی، تخصص عمیقتری به آن میبخشد.

بهترین راهحل در بیشتر پروژههای مدرن، ترکیب هر دو روش است:

مدلی که هم بفهمد و هم از بیرون یاد بگیرد.